Ssa!

스파르타 내일배움캠프 딥러닝 역사 본문

기존의 머신러닝은 AND, OR문제로 시작한다.

문제를 풀기 위해서 직선 하나(논리회귀)로 쉽게 만들 수 있다.

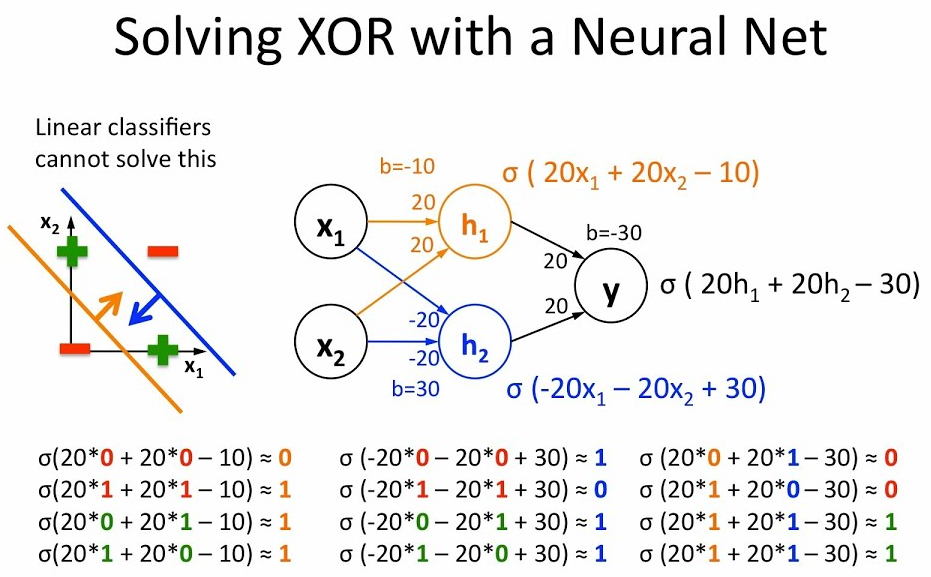

선형회귀로는 AND, OR 문제는 잘 풀지만 XOR문제는 풀지 못했다.

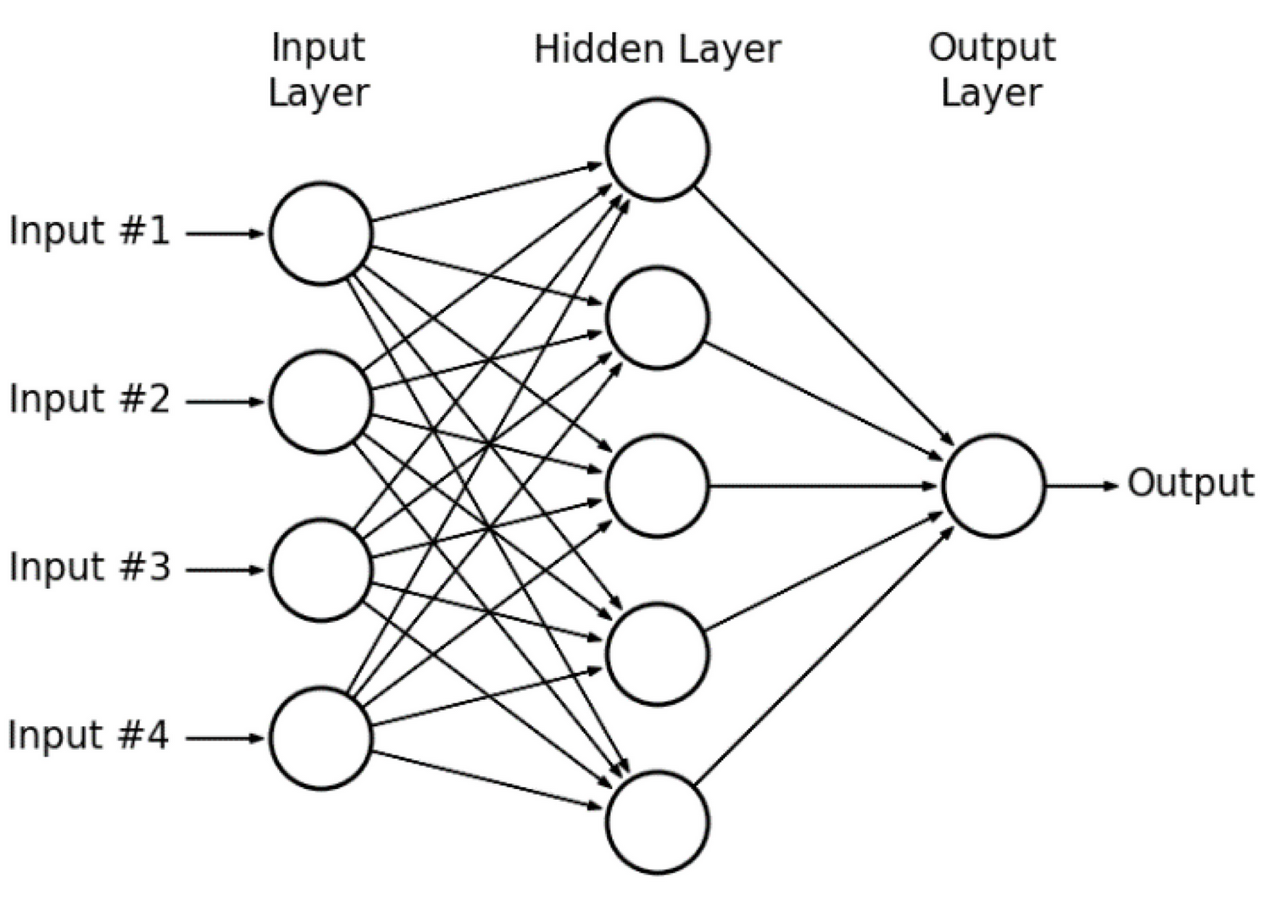

Perceptron을 여러개 붙인 Multilayer Perceptrons (MLP)라는 개념을 도입해서 문제를 풀어보려고 했다.

MLP로 XOR문제를 풀려고 했지만 불가능했고 MLP를 써야하는데 각각의 weight와 bias를 학습시키는데 너무 많은 계산이 필요하므로 당시 기술로는 불가능하다고 생각했다.

이 문제를 포기하게 되고 딥러닝의 발전은 10년 ~ 20년 정도 후퇴하게 된다.

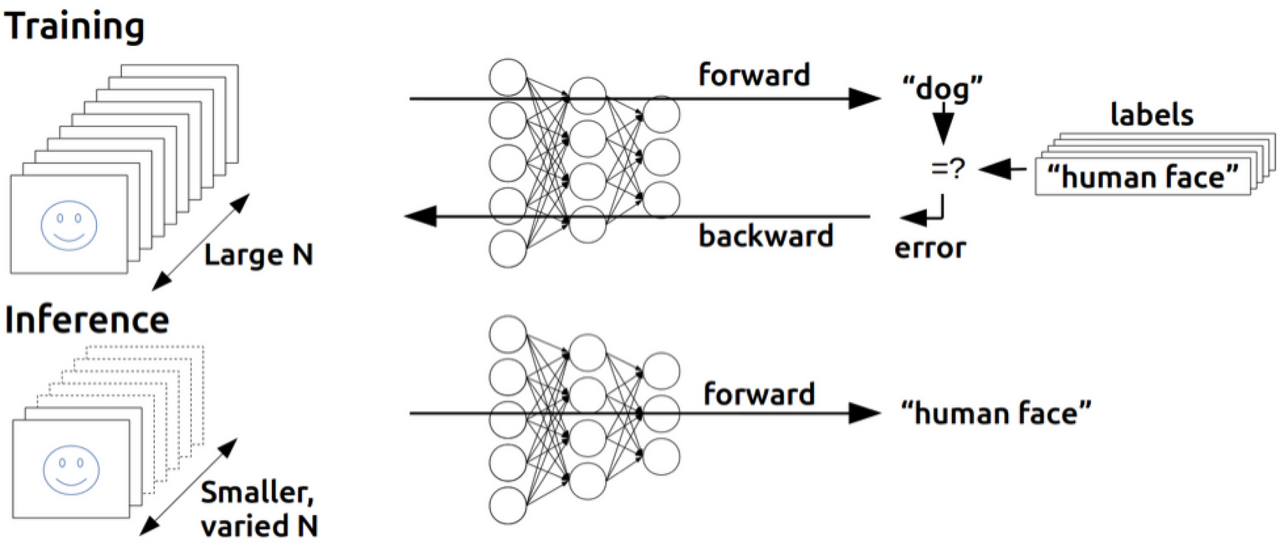

이 문제를 해결하기 위해서 Backpropagation (역전파)으로 해결하게 된다

1. W(weight)와 b(bias)를 이용하여 주어진 입력을 가지고 출력을 만들어 낼 수 있다

2. MLP가 만들어낸 출력이 정답값과 다를 경우 W와 b를 조절해야한다.

3. 조절하는 가장 좋은 방법은 출력에서 Error(오차)를 발견하여 뒤에서 앞으로 점차 조절하는 방법이 필요하다.

이 알고리즘은 관심받지 못하다 XOR문제를 MLP로 풀 수 있게 되어 해결될 수 있었고 핵심방법은 역전파 알고리즘의 발견이다.

'CS > 머신러닝' 카테고리의 다른 글

| 스파르타 내일배움캠프 딥러닝 (0) | 2022.10.13 |

|---|---|

| 스파르타 내일배움캠프 머신러닝에서의 전처리 (0) | 2022.10.11 |

| 스파르타 내일배움캠프 다양한 머신러닝 모델 (0) | 2022.10.11 |

| 스파르타 내일배움캠프 다항 논리 회귀, Softmax 함수와 손실함수 (0) | 2022.10.11 |

| 스파르타 내일배움캠프 논리 회귀, 가설, 손실함수 (1) | 2022.10.11 |